Artificiell intelligens har på kort tid blivit ett kraftfullt verktyg i forskningen. Den kan formulera text, strukturera argument och till och med bidra till nya vetenskapliga insikter. Och det går snabbt. Många forskare har insett detta och författar nu artiklar med hjälp av AI, ofta utan att det framgår. Varför medge att man fått avsevärd hjälp och avstå från den prestige som följer med en stark forskningsartikel?

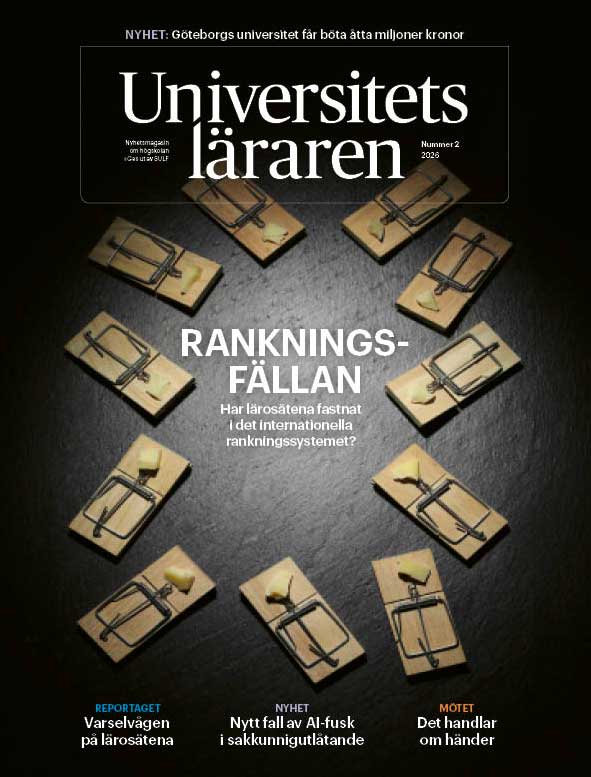

Samtidigt brottas akademiska tidskrifter med en fråga som tycks sakna svar: Hur avgör man om en artikel är skriven av en människa eller av en AI? Det korta svaret är: det kan man inte. Och viktigare – det är fel fråga.

I dag läggs betydande energi på att försöka utveckla verktyg som kan ”detektera” AI-genererad text. Dessa metoder är notoriskt opålitliga och kan enkelt kringgås. AI-detekterande verktyg kan i dag inte skilja på om AI tagit forskarens plats eller om AI endast använts för språkputsning. De försök som gjorts, exempelvis med ”vattenmärkning”, har inte varit framgångsrika. Att i efterhand försöka avgöra hur en text har skrivits är därför förmodligen en återvändsgränd.

Jan Scheffel

Professor emeritus, KTH

Det verkliga problemet är emellertid inte att AI används. Problemet är att forskningssystemet belönar en bild av den ensamma, geniala forskaren som producerar djupa insikter på egen hand. Det förhållningssättet blir nu alltmer förlegat. När AI gör det möjligt att nå avancerade resultat snabbare, uppstår därför en frestelse: att använda verktygen, men inte berätta om det.

En rimlig reaktion är att vilja granska forskningsprocessen snarare än slutprodukten. En vetenskaplig tidskrift kan exempelvis begära in artikelförfattarens underlag och olika versioner. Men vill vi verkligen gå den vägen? Vetenskaplig kvalitet bör ju inte bedömas utifrån hur ”mänsklig” processen varit. De centrala kraven måste fortsatt vara att resultaten är korrekta, intressanta och reproducerbara.

Däremot finns det ett avgörande krav: författaren måste ha fullt intellektuellt ägarskap över innehållet. Det innebär att forskaren ska kunna uppvisa förståelse, det vill säga kunna förklara och försvara varje del av arbetet, oavsett vilka verktyg som använts.

Det här kravet är mer långtgående än vad det först verkar. Om författaren skulle deklarera att AI inte alls använts, kan detta enkelt testas, med hög säkerhet, med verktyg som GPT Zero. Det går däremot inte att avgöra om AI endast använts för språkbehandling eller för mer avancerade uppgifter, men utfallet av testet kan med stor säkerhet avgöra om AI alls har bidragit. Författaren får bakläxa och måste redovisa hur samarbetet gått till. Och är det så att AI har använts, men inte deklarerats i full utsträckning, får forskaren vara beredd på att kollegor, som oftast har en relativt god bild av forskarens kompetens, kan ha åsikter om arbetet.

”I stället för att, med måttlig framgång, försöka avslöja långtgående AI-användning kan alltså forskarsamhället göra något betydligt mer effektivt: göra öppenhet till norm och merit.”

I stället för att, med måttlig framgång, försöka avslöja långtgående AI-användning kan alltså forskarsamhället göra något betydligt mer effektivt: göra öppenhet till norm och merit.

Jag föreslår därför följande:

1. Obligatorisk deklaration av AI-användning

Artiklar bör innehålla en kort redogörelse för hur AI har använts – exempelvis för språkgranskning, strukturering eller idéutkast.

2. Tydligt författaransvar

Författare ska intyga, både för tidskriftsredaktionen och i samband med publicering, att de förstår och kan argumentera för hela innehållet.

3. Erkännande av verktygskompetens

Att använda avancerade verktyg effektivt bör ses som en styrka, inte en svaghet. Transparens ska inte minska prestige – utan öka den.

Vetenskaplig verksamhet innebär som regel hårt arbete, där den faktiska processen utgörs av en hel del inläsning av tidigare litteratur, hypotesbildning, prövande och förkastande av idéer, men även fruktbara synteser. Ett dolt användande av AI riskerar snarare att förstärka forskningsprocessens missvisande karaktär av skarpsinnig elegans, där viktiga delar av kunskapsbildningen undertrycks. Om vi i stället premierar öppenhet avseende AI kan vi få motsatsen: en rikare och mer realistisk bild av hur vetenskapliga framsteg faktiskt uppnås.

Frågan är alltså inte om AI används i forskningen – det gör den redan. Frågan är om vi vill ha ett system där detta sker i det fördolda, eller ett där det sker öppet och ansvarsfullt.

Att försöka skilja mellan ”mänsklig” och ”AI-genererad” text är fel väg att gå. Det vi behöver är något mer värdefullt: ett forskningssystem som belönar de som tydligt visar hur kunskap framgångsrikt produceras i samarbete med AI. AI-assistans ska alltså deklareras fullt ut i samband med vetenskapliga artiklar.

Det kommer inte att dröja länge innan det snarare är så att AI behöver deklarera humant samarbete vid publicering av forskningsresultat, men det är en annan historia.

Jan Scheffel

Professor emeritus, KTH

AI-assistans:

Chat GPT (Open AI) användes för att generera utkast och förbättra formuleringar.

Författaren har granskat, modifierat och ansvarar för allt innehåll.