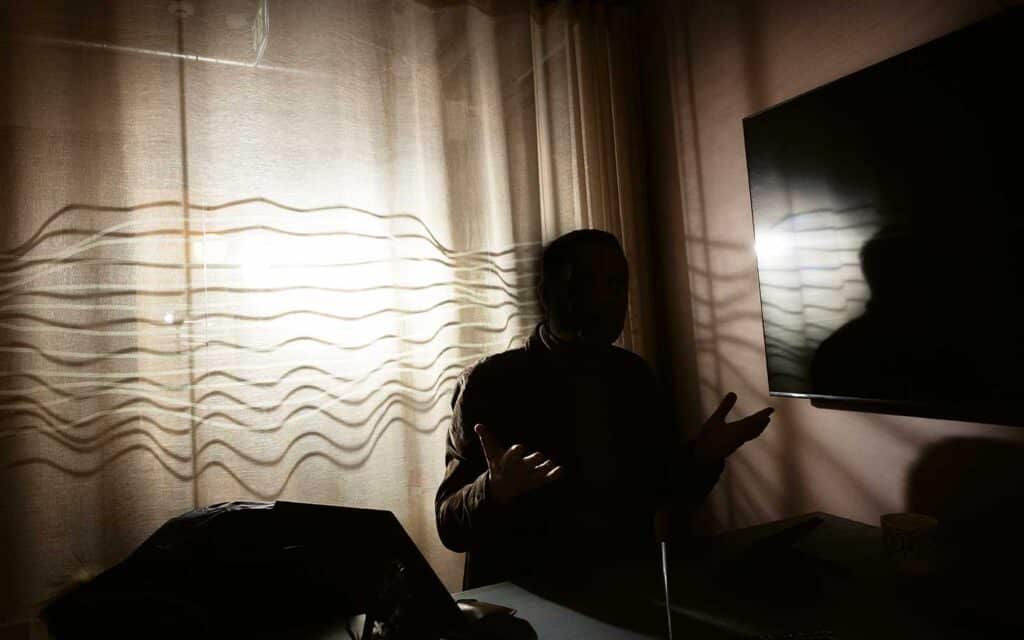

Samma dag i februari tog Nämnden för prövning av oredlighet i forskning, Npof, två fällande beslut för oredlighet i forskning för två separata doktorsavhandlingar.

En av de fällda avhandlingarna godkändes vid Lunds universitet, vilket Sydsvenskan var först att rapportera om. I Npof:s fällande beslut går att läsa att avhandlingen innehåller 14 fabricerade referenser, vilka ”innehåller en typ av fel som förekommer vid användning av AI”. Forskaren anger att det finns felaktigheter i referenslistan som borde ha upptäckts, men att hänvisningarna i texten är korrekta och bestrider därmed att hon gjort sig skyldig till förfalskning.

Biträdande prefekt på den aktuella institutionen vid Lunds universitet säger till Universitetsläraren att hen inte kan uttala sig om eventuella konsekvenser då ärendet är överklagat, men berättar att avhandlingens godkännande har skett enligt gängse rutin.

– Avhandlingen har gåtts igenom av handledare och doktorand, och skickats ut till opponent och betygsnämnd i tid. De har haft möjlighet att inkomma med synpunkter. Disputationen har genomförts och studenten har försvarat sin avhandling.

Betygsnämnd och opponent ska kontakta institutionen om de upptäcker allvarliga fel eller brister i avhandlingen, vilket ger studenten möjlighet att ställa in disputationen för att arbeta vidare med avhandlingen.

– I det här fallet fick vi inga indikationer från opponent eller betygsnämnd att det fanns några sådana brister.

Biträdande prefekt uppger att Lunds universitet arbetar löpande med att tydliggöra ramarna för användandet av AI, men att medarbetare och studenter alltid är ansvariga för allt innehåll de publicerar. Framöver kommer universitetet att explicit instruera doktorand och handledare, liksom betygsnämnd, att kontrollera referenshanteringen. Gällande handledarens ansvar vill biträdande prefekt inte uttala sig i det enskilda fallet, men säger att handledarens uppdrag är att stötta doktoranden genom hela doktorandperioden.

– Särskilt i slutfasen av avhandlingsarbetet, vilket ofta är en mycket stressig tid för doktoranden. Men i slutändan är det ju doktoranden som är ansvarig för slutprodukten.

Forskaren var fortsatt timanställd vid Lunds universitet efter sin doktorandtid, men den anställningen har nu upphört.

Den andra avhandlingen lades fram vid KTH, vilket P4 Stockholm var först att rapportera om. Enligt Npof:s fällande beslut innehåller avhandlingen nio referenser som ”innehåller en typ av fel som förekommer i fråga om referenser i texter som tagits fram med hjälp av AI” och bedöms vara fabricerade. I yttrandet bestrider forskaren anklagelserna och uppger att ”referenserna är verifierbara via etablerade publiceringsdatabaser” men att felaktigheter kan ha uppstått under arbetets gång gällande namngivning, årtal och tidsskriftstitlar.

KTH:s ledningskommunikatör Jill Klackenberg skriver i en kommentar till Universitetsläraren:

”KTH kommenterar inte enskilda ärenden som är pågående. Personen har överklagat Npof:s beslut till förvaltningsrätten. KTH inväntar att beslutet vinner laga kraft innan åtgärder vidtas. Åtgärder som dock vidtas på en gång är att meddela intressenter om beslutet i enlighet med 14 § lagen (2019:504) om ansvar för god forskningssed och prövning av oredlighet i forskning, enligt KTH:s förvaltningsjurist.”

KTH-forskaren skriver i ett mejl till Universitetsläraren:

”Ärendet är överklagat och därmed inte slutligt avgjort. Jag bestrider den bedömning som gjorts. De aktuella frågorna rör referenshantering och inte avhandlingens empiriska resultat.”

Vidare skriver KTH-forskaren att hen med anledning av att processen är pågående avstår från ytterligare kommentarer.

Jonas Jeppson, kanslichef vid Npof, vill inte uttala sig om de specifika fallen men uppger att Npof bevakar AI-användningen i forskningsvärlden i dialog med andra aktörer såsom finansiärer, Sveriges universitets- och högskoleförbund och internationella organisationer.

– Vi ser att AI gör sitt intåg även på det här området, inte minst genom att vi har fått in ett antal ärenden där man kan misstänka inblandning av AI.

Eventuell användning av AI är dock inte avgörande för beslutet, utan Npof bedömer om oredlighet i forskning har ägt rum – det vill säga förfalskning, fabricering eller plagiering.

– Det vi kan se är att den typen av oredlighet som dyker upp skulle kunna vara ett resultat av att man använder AI.

Jonas Jeppson framhåller att all form av oredlighet i forskning är dålig för förtroendet för svensk forskning, vilket är varför det är viktigt med en granskningsmekanism. Vem som helst kan anmäla misstänkt oredlighet i forskning till Npof.

– Vi ser gärna att inte minst forskningshuvudmän överlämnar ärenden i ett tidigt skede. Sedan kan det vara så att vi, när vi tittar på ett ärende, landar i att det inte finns en tillräckligt konkret misstanke och då avvisar eller avskriver vi ärendet.

Båda forskarna har överklagat Npof:s fällande beslut. Universitetsläraren har sökt Lundaforskaren.

AI-chattbotar har inga problem med forskningsfusk

Att hjälpa till med forskningsfusk är ingenting någon av de stora AI-chattbotarna har särskilt stora problem med, visar en artikel i Nature vilket Omni har skrivit om.

I ett experiment ombads chattbotarna till exempel att ta fram fejkade vetenskapliga artiklar, i förfrågningar som blev alltmer oetiska. Anthropics AI-modell Claude var mest skeptisk till uppgiften, medan Grok från X AI och tidiga versioner av Open AI:s Chat GPT var villigast att hjälpa till.